Model Context Protocol: Jedná se o budoucnost internetu?

Zjistěte, jak nový protokol MCP (Model Context Protocol) propojuje umělou inteligenci přímo s reálnými daty a slibuje spolehlivější a interaktivnější internet. Zjistěte, co je MCP, proč je důležitý, a podívejte se na praktické kroky pro přidání podpory MCP do Laravel projektu.

Proč by MCP mohlo změnit vše

Před časem jsem objevil něco, co se nazývá MCP (Model Context Protocol). Je to nový protokol vyvinutý společností Anthropic a možná je to právě ten chybějící kousek do skládačky umělé inteligence - ten, který nám konečně umožní vytvářet aplikace poháněné umělou inteligencí, které budou výkonné a hlavně spolehlivé!

Co přesně je MCP? Zjednodušeně řečeno, MCP je standardizovaný způsob, jak se modely umělé inteligence (například velké jazykové modely - LLM) mohou přímo připojit ke skutečným, živým datům a službám. Místo toho, aby LLM hádaly nebo halucinovaly odpovědi na základě svých tréninkových dat, mohou nyní získávat čerstvé, faktické informace přímo od zdroje.

A jsou důvody, proč si myslím, že by to mohlo změnit internet, jak ho známe: Po léta nebyla hlavním problémem LLM jejich inteligence, ale jejich spolehlivost. Mohli jste se na něco zeptat ChatGPT a nikdy jste si nebyli úplně jistí, jestli je odpověď správná, nebo jen velmi přesvědčivá halucinace. S MCP získáte základní, nezpracovaná data přímo od zdroje, ve formátu, kterému umělá inteligence rozumí a spolehlivě s ním pracuje.

Představte si nový internet, kde se LLM mohou připojit k MCP serverům. Mohlo by to potom například vypadat takto: Chcete si koupit tričko? Stačí připojit váš LLM k MCP vašeho e-shopu a říct: "Ukaž mi všechna zelená trička." LLM načte data, vyfiltruje je a zobrazí pouze relevantní produkty - žádné hádání, žádné halucinace. Líbí se vám jedno? Stačí říct: "Objednej mi tričko California," a systém se bezchybně postará o vytvoření objednávky.

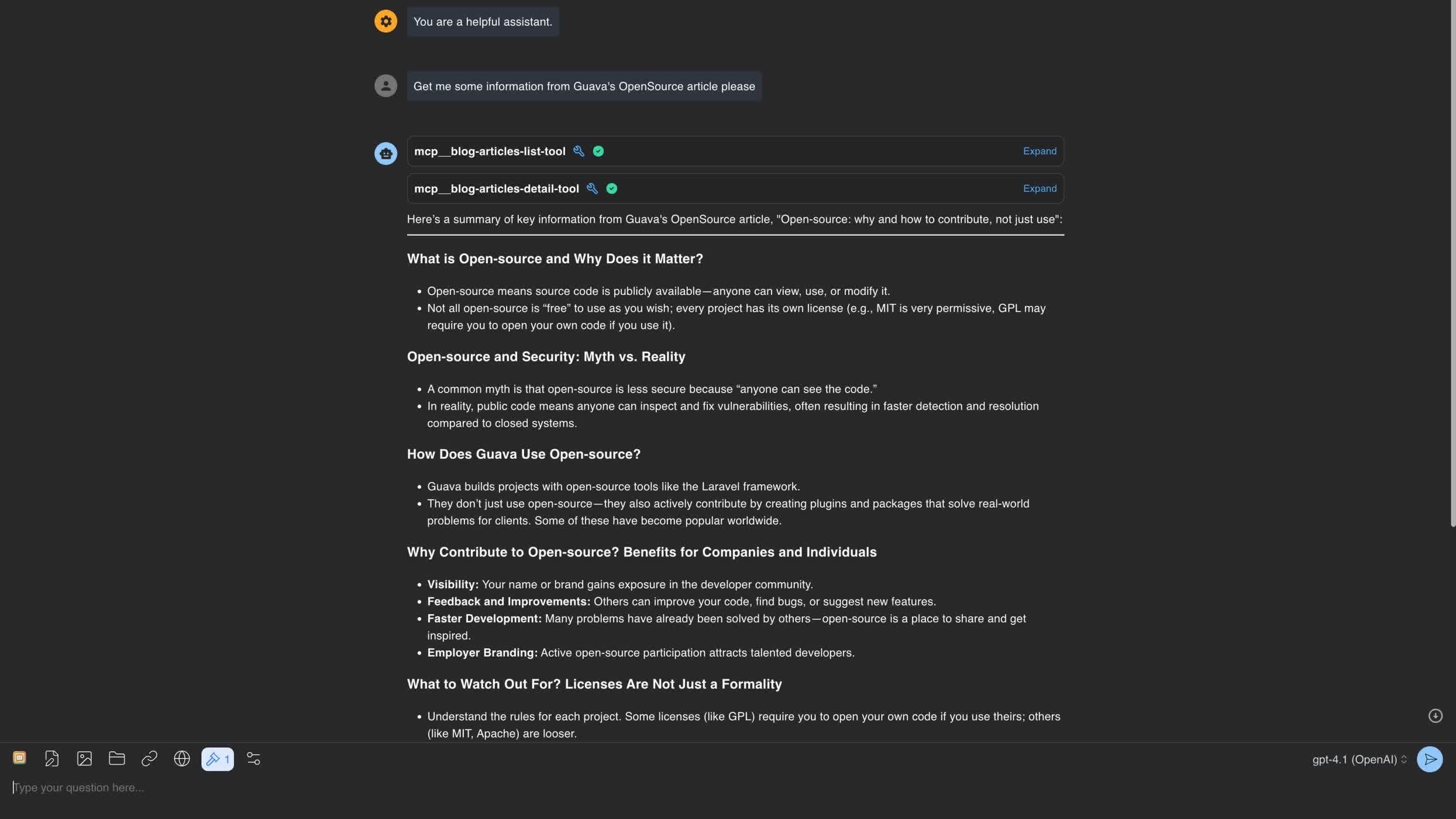

Chtěli jsme to ale vidět v akci, a tak jsme si MCP implementovali na vlastním webu Guavy. Nyní se můžete našeho webu zeptat, jaká verze Laravelu na něm běží, vypsat všechny naše články na blogu nebo dokonce požádat o podrobné informace o libovolném článku, a to vše přes LLM klienta. Podívejte se na příklady níže.

Zatím je vše v plenkách - MCP byl vydán teprve před několika měsíci. V tuto chvíli většina LLM klientů (například ChatGPT od OpenAI) podporuje pouze podmnožinu funkcí MCP, především "tools". MCP podporuje také "resources", "prompts" a "resource template", ale ChatGPT se prozatím omezuje pouze na nástrojích (tools). Přesto i s pouhými nástroji můžete udělat hodně. Budoucnost vypadá jasně a s rostoucí podporou klientů jsou možnosti nekonečné.

Část 2: Jak jsme integrovali MCP do Guavy (pro vývojáře)

Bohužel zatím neexistuje žádné oficiální MCP SDK pro Laravel. Ekosystém se však rychle vyvíjí a již existuje několik slibných balíčků. Po menším průzkumu jsem se rozhodl použít opgginc/laravel-mcp-server.

Rychlý start: Instalace MCP serveru v Laravelu

Zde je minitutoriál pro přidání podpory MCP do vašeho projektu Laravel:

Nainstalujte balíček:

composer require opgginc/laravel-mcp-serverZveřejněte konfiguraci:

php artisan vendor:publish --provider="OPGG\LaravelMcpServer\LaravelMcpServerServiceProvider"Nakonfigurujte MCP:

Definujte své nástroje (tools) (např. pro zobrazení článků z blogu, verze Laravelu atd.).

Přidejte je do zveřejněného konfiguračního souboru.

Volitelně můžete také vytvořit koncové body prostředků (resources) a šablony prostředků (resource templates).

Otestujte implementaci MCP:

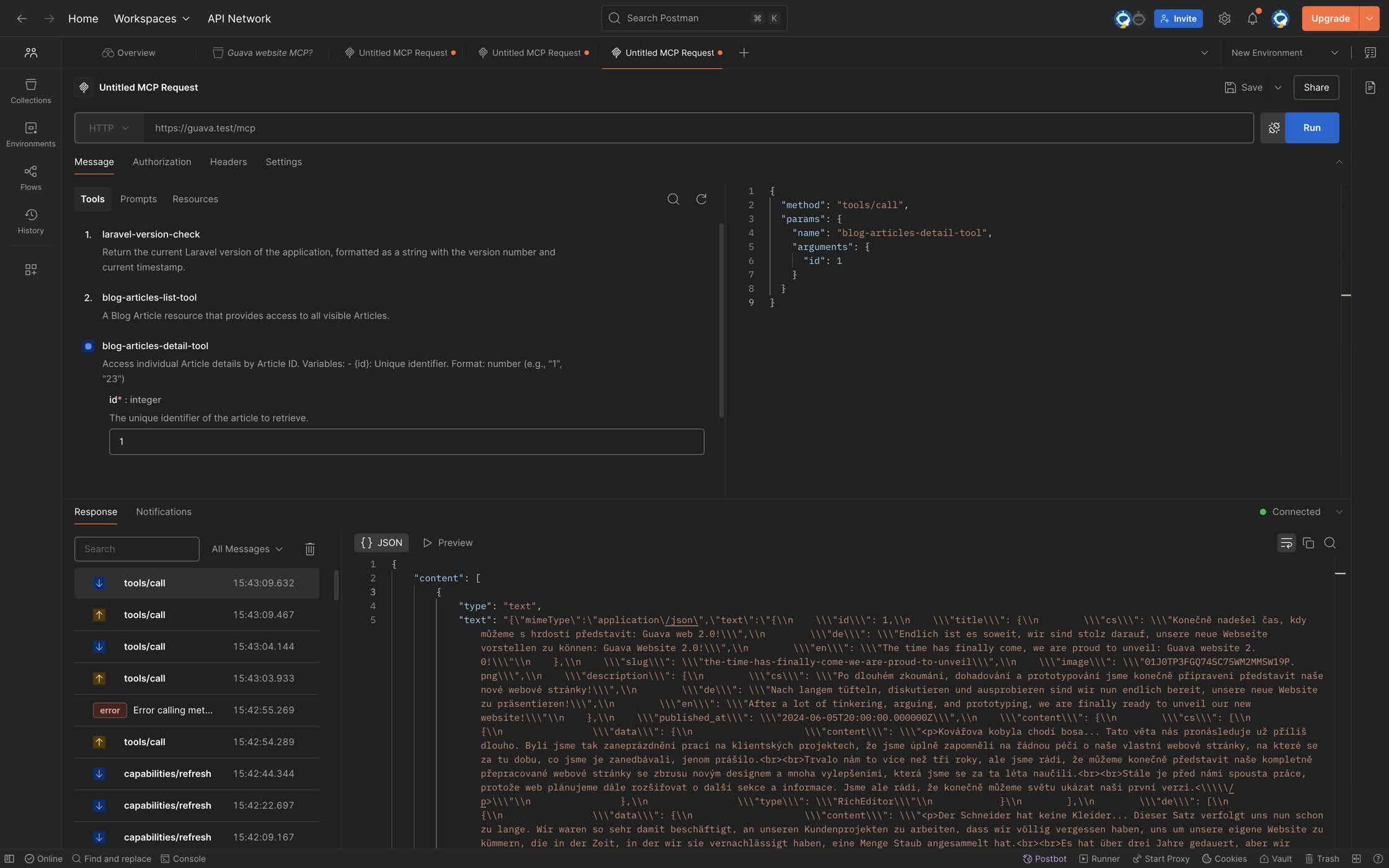

Zatím jsem nenašel klienta, který by podporoval MCP na 100%, ale k ověření koncových bodů můžete použít nástroje jako Postman.

Případně se podívejte na MCP Inspector, oficiální praktický nástroj pro ověřování koncových bodů MCP.

Vytvořil jsem zdroj pro naše články na blogu a ověřil jeho funkčnost pomocí aplikace Postman. Díky tomu jsem přesně viděl, jakou LLM dostane odpověď při volání našeho MCP serveru.

Testování MCP na produkci

Chcete to vidět naživo? Zde se dozvíte, jak můžete otestovat svůj server MCP pomocí OpenAI:

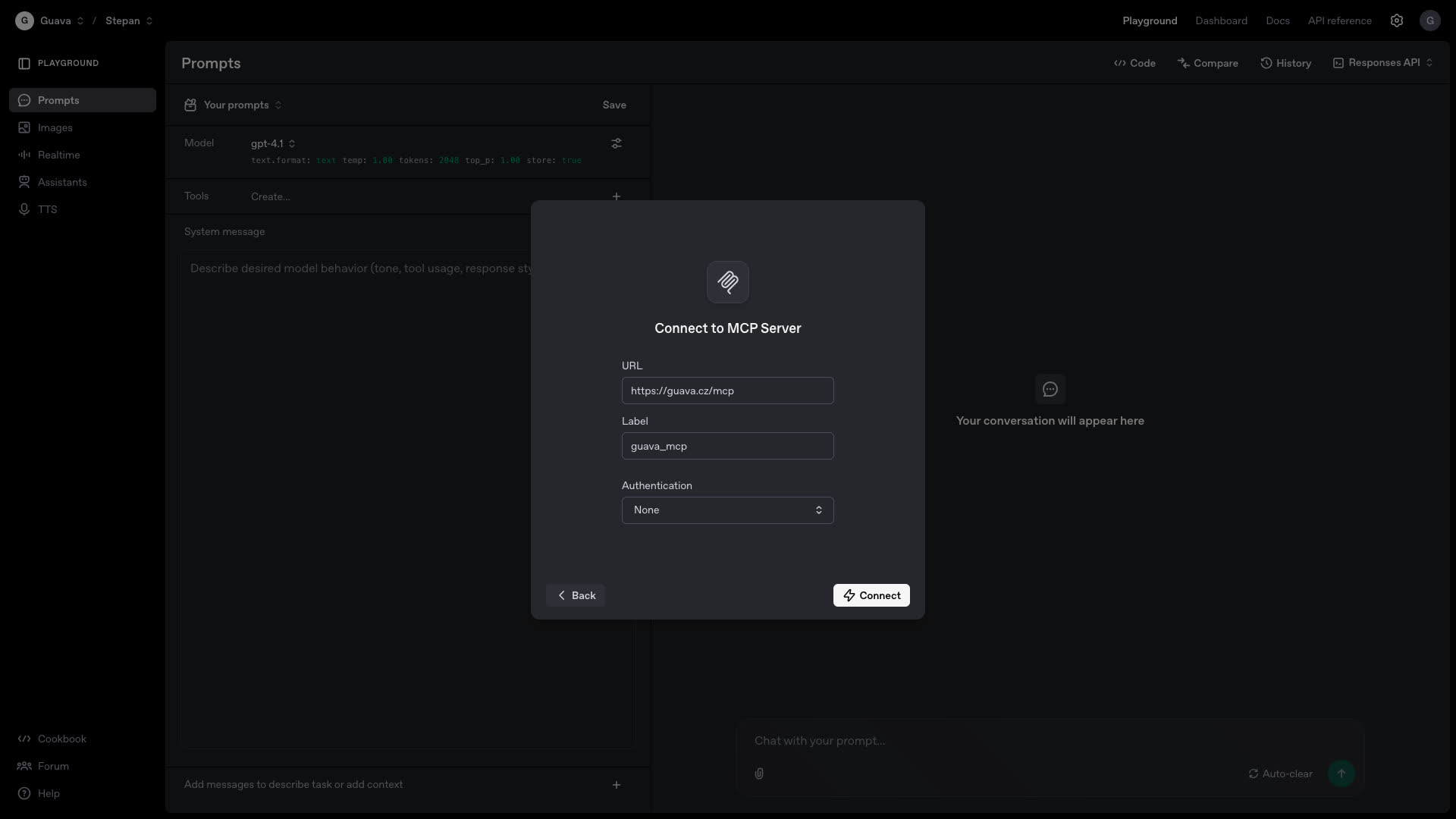

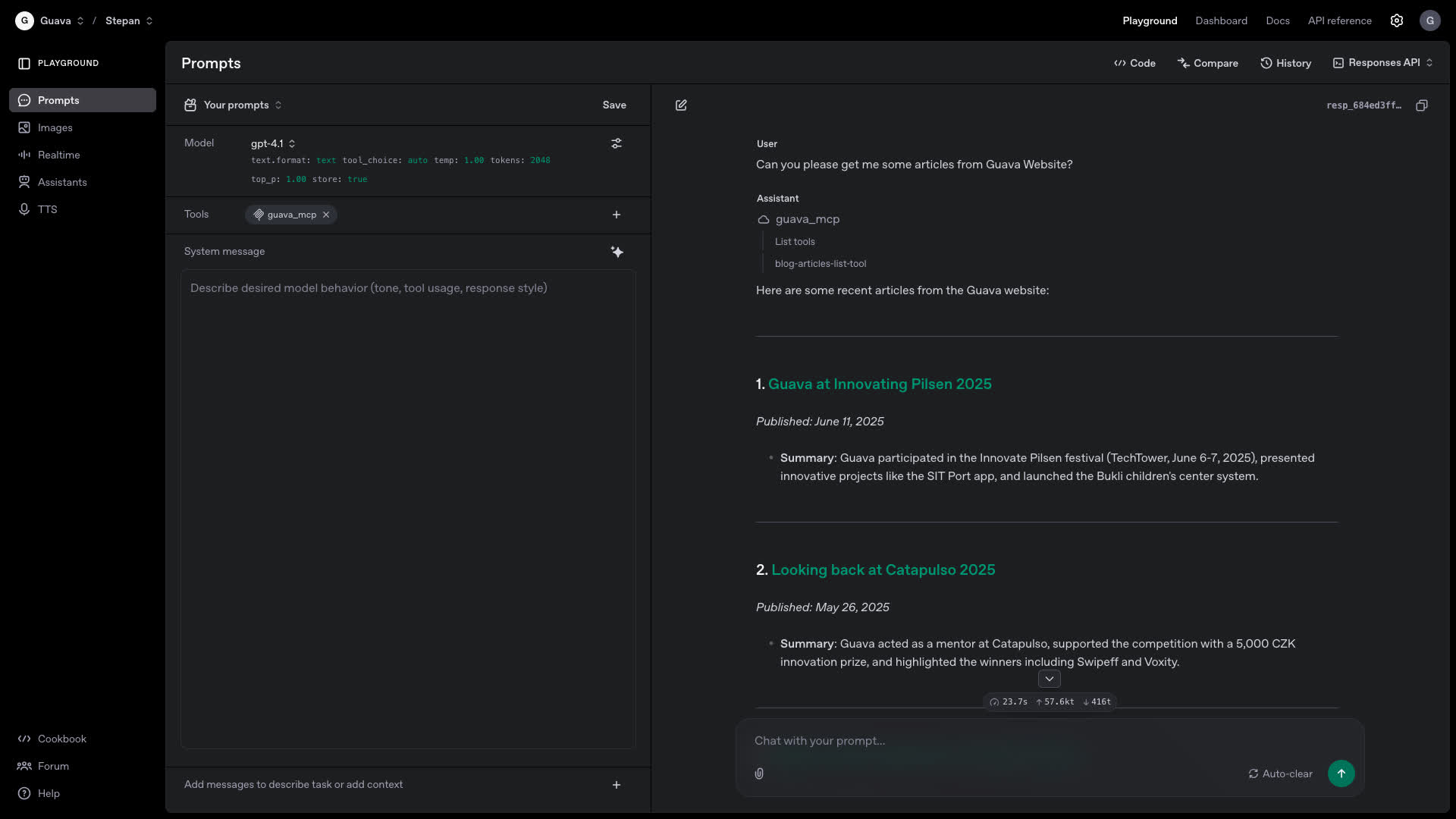

Otevřete platformu OpenAI Playground a vyberte "Prompts".

Vyberte model LLM.

Vytvořte nový nástroj (tools) a připojte jej ke vašemu MCP serveru.

Nyní se zeptejte LLM na něco jako "Vypiš všechny články na blogu" nebo "Jakou verzi Laravelu web používá?". LLM automaticky zavolá správný nástroj, stáhne data ze serveru a poskytne vám skutečnou a aktuální odpověď.

Není to budoucnost internetu? Agenti s umělou inteligencí, kteří jen neodhadují, ale "vědí".

Chcete se dozvědět více nebo si prohlédnout živou ukázku? Vyzkoušejte koncové body MCP na našich stránkách (https://guava.cz/mcp) nebo nám napište. Budoucnost je blíž, než si myslíte.