Modell-Kontext-Protokoll: Ist dies die Zukunft des Internets?

Erfahren Sie, wie das neue Model Context Protocol (MCP) KI direkt mit echten Daten verbindet und ein zuverlässigeres und interaktiveres Internet verspricht. Erfahren Sie, was MCP ist, warum es wichtig ist und sehen Sie praktische Schritte, um MCP-Unterstützung zu Ihrem Laravel-Projekt hinzuzufügen.

Warum MCP alles verändern könnte

Vor einiger Zeit entdeckte ich etwas namens MCP (Model Context Protocol). Es handelt sich um ein neues, von Anthropic entwickeltes Protokoll, das vielleicht das fehlende Teil im KI-Puzzle ist - das Teil, das es uns endlich ermöglichen wird, KI-gestützte Anwendungen zu entwickeln, die leistungsstark und vor allem zuverlässig sind!

Was genau ist MCP? Einfach ausgedrückt ist MCP ein standardisierter Weg für KI-Modelle (wie z. B. große Sprachmodelle - LLMs), sich direkt mit realen, lebenden Daten und Diensten zu verbinden. Anstatt dass LLMs auf der Grundlage ihrer Trainingsdaten Antworten erraten oder halluzinieren, können sie nun frische, sachliche Informationen direkt von der Quelle erhalten.

Und es gibt Gründe, warum ich glaube, dass dies das Internet, wie wir es kennen, verändern könnte: Jahrelang war das Hauptproblem mit LLMs nicht ihre Intelligenz, sondern ihre Zuverlässigkeit. Man konnte ChatGPT eine Frage stellen und sich nie ganz sicher sein, ob die Antwort richtig war oder nur eine überzeugende Halluzination. Mit MCP erhalten Sie grundlegende Rohdaten direkt von der Quelle, in einem Format, das die KI versteht und mit dem sie zuverlässig arbeiten kann.

Stellen Sie sich ein neues Internet vor, in dem sich LLMs mit MCP-Servern verbinden können. Es könnte dann zum Beispiel so aussehen: Sie möchten ein T-Shirt kaufen? Verbinden Sie einfach Ihr LLM mit dem MCP Ihres E-Commerce-Geschäfts und sagen Sie: "Zeig mir alle grünen T-Shirts." Der LLM liest die Daten, filtert sie und zeigt nur relevante Produkte an - kein Rätselraten, keine Halluzinationen. Möchten Sie eins? Sagen Sie einfach: "Bestellen Sie mir ein T-Shirt aus Kalifornien", und das System wird sich problemlos um die Erstellung der Bestellung kümmern.

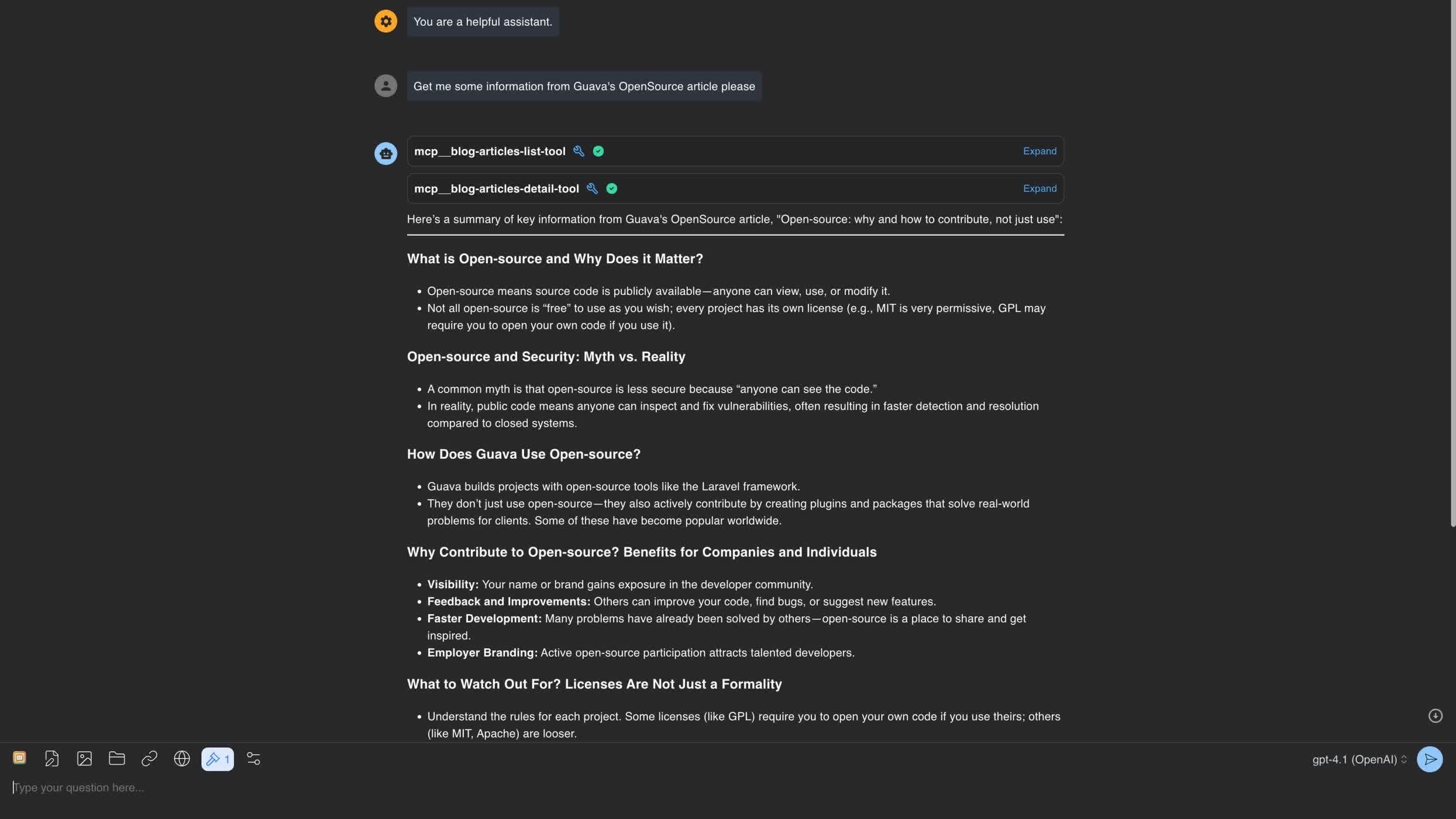

Aber wir wollten es in Aktion sehen, also haben wir MCP auf der Guava-Website implementiert. Jetzt können Sie über den LLM-Client abfragen, welche Laravel-Version auf unserer Website läuft, alle unsere Blog-Artikel auflisten oder sogar detaillierte Informationen zu jedem Artikel anfordern. Sehen Sie sich die Beispiele unten an.

Bis jetzt steckt alles noch in den Kinderschuhen - MCP wurde erst vor ein paar Monaten veröffentlicht. Im Moment unterstützen die meisten LLM-Clients (wie ChatGPT von OpenAI) nur eine Teilmenge der MCP-Funktionen, hauptsächlich "Werkzeuge". MCP unterstützt auch "Ressourcen", "Prompts" und "Ressourcenvorlagen", aber ChatGPT ist im Moment auf Werkzeuge beschränkt. Aber selbst mit den Tools kann man eine Menge machen. Die Zukunft sieht rosig aus und mit zunehmender Kundenunterstützung sind die Möglichkeiten endlos.

Teil 2: Wie wir MCP in Guava integriert haben (für Entwickler)

Leider gibt es noch kein offizielles MCP-SDK für Laravel. Das Ökosystem entwickelt sich jedoch schnell weiter und es gibt bereits mehrere vielversprechende Pakete. Nach ein wenig Recherche habe ich mich für opgginc/laravel-mcp-server entschieden.

Schnellstart: Installieren des MCP-Servers in Laravel

Hier ist ein Mini-Tutorial zum Hinzufügen von MCP-Unterstützung zu Ihrem Laravel-Projekt:

Installieren Sie das Paket:

composer require opgginc/laravel-mcp-serverVeröffentlichen Sie die Konfiguration:

php artisan vendor:publish --provider="OPGG\LaravelMcpServer\LaravelMcpServerServiceProvider"Konfigurieren Sie den MCP:

Definieren Sie Ihre Tools (z. B. für die Anzeige von Blogartikeln, Laravel-Versionen usw.).

Fügen Sie sie der veröffentlichten Konfigurationsdatei hinzu.

Optional können Sie auch Ressourcenendpunkte und Ressourcenvorlagen erstellen.

Testen Sie die MCP-Implementierung:

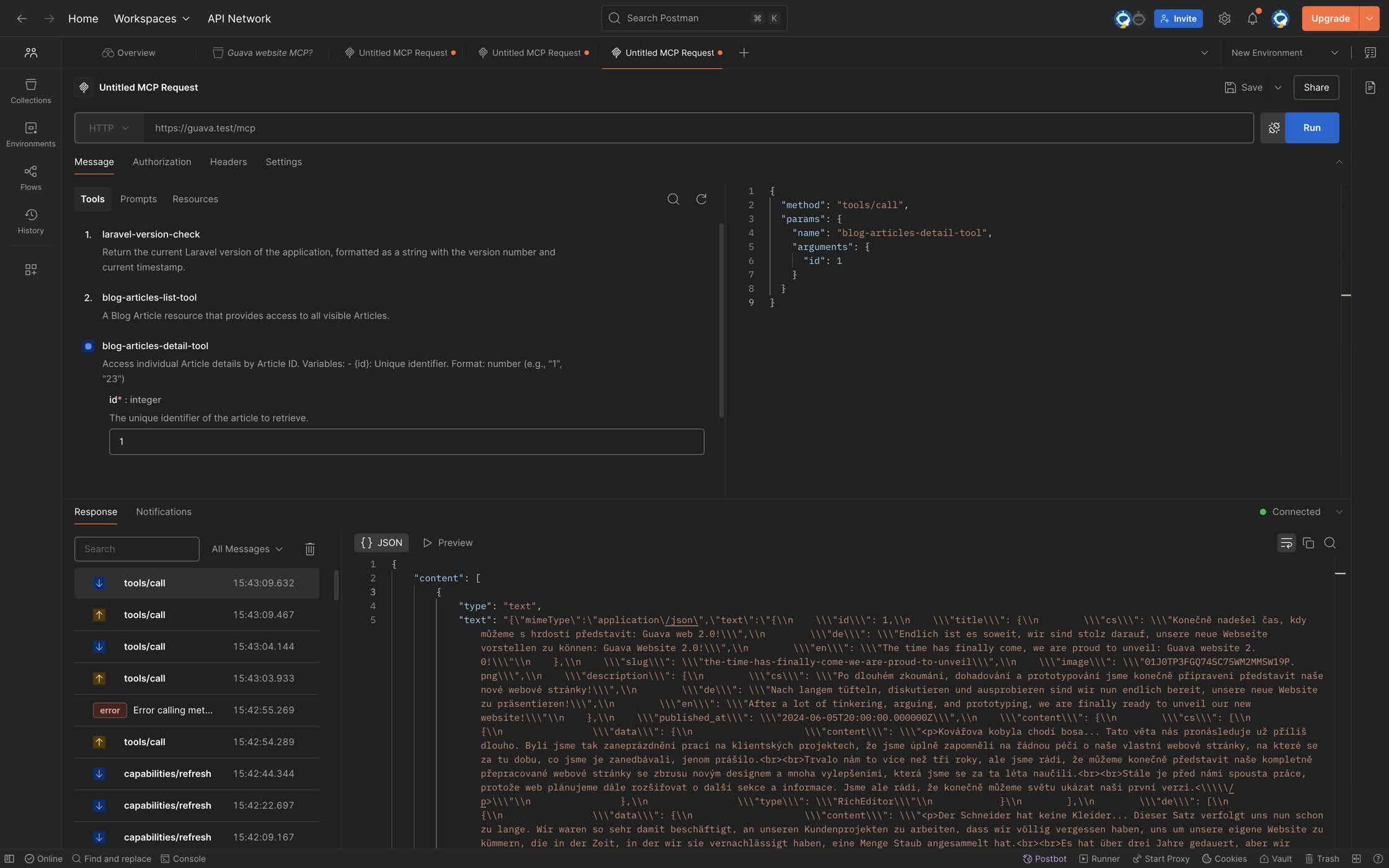

Ich habe noch keinen Client gefunden, der MCP zu 100% unterstützt, aber Sie können Tools wie Postman verwenden, um die Endpunkte zu überprüfen.

Alternativ können Sie auch den MCP Inspector nutzen, das offizielle praktische Tool zur Überprüfung von MCP-Endpunkten.

Ich habe einen Feed für unsere Blogartikel erstellt und seine Funktionalität mit Postman überprüft. So konnte ich genau sehen, welche Antwort LLM beim Aufruf unseres MCP-Servers erhalten würde.

MCP-Prüfung in der Produktion

Willst du sie live sehen? Erfahren Sie hier, wie Sie Ihren MCP-Server mit OpenAI testen können:

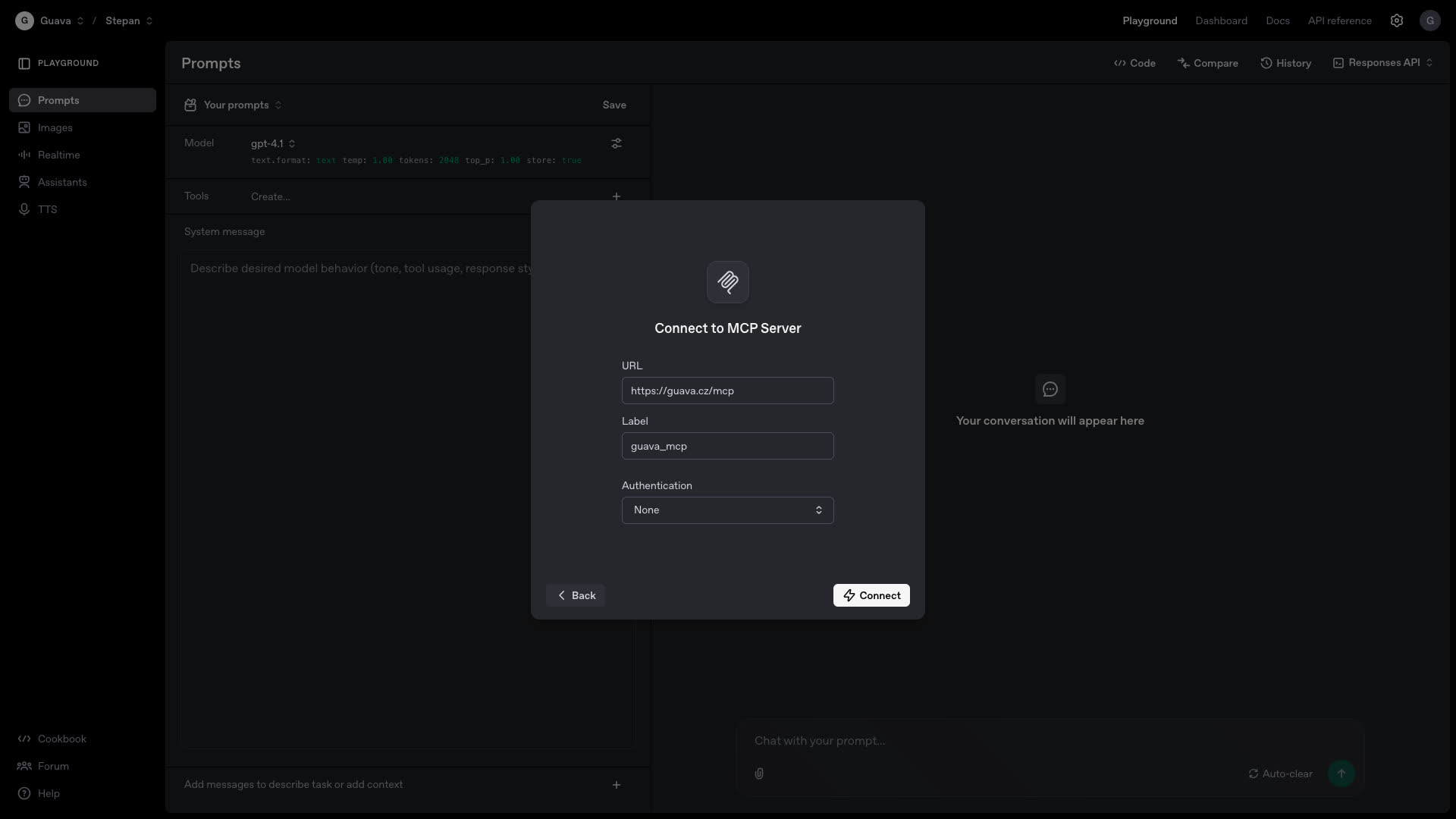

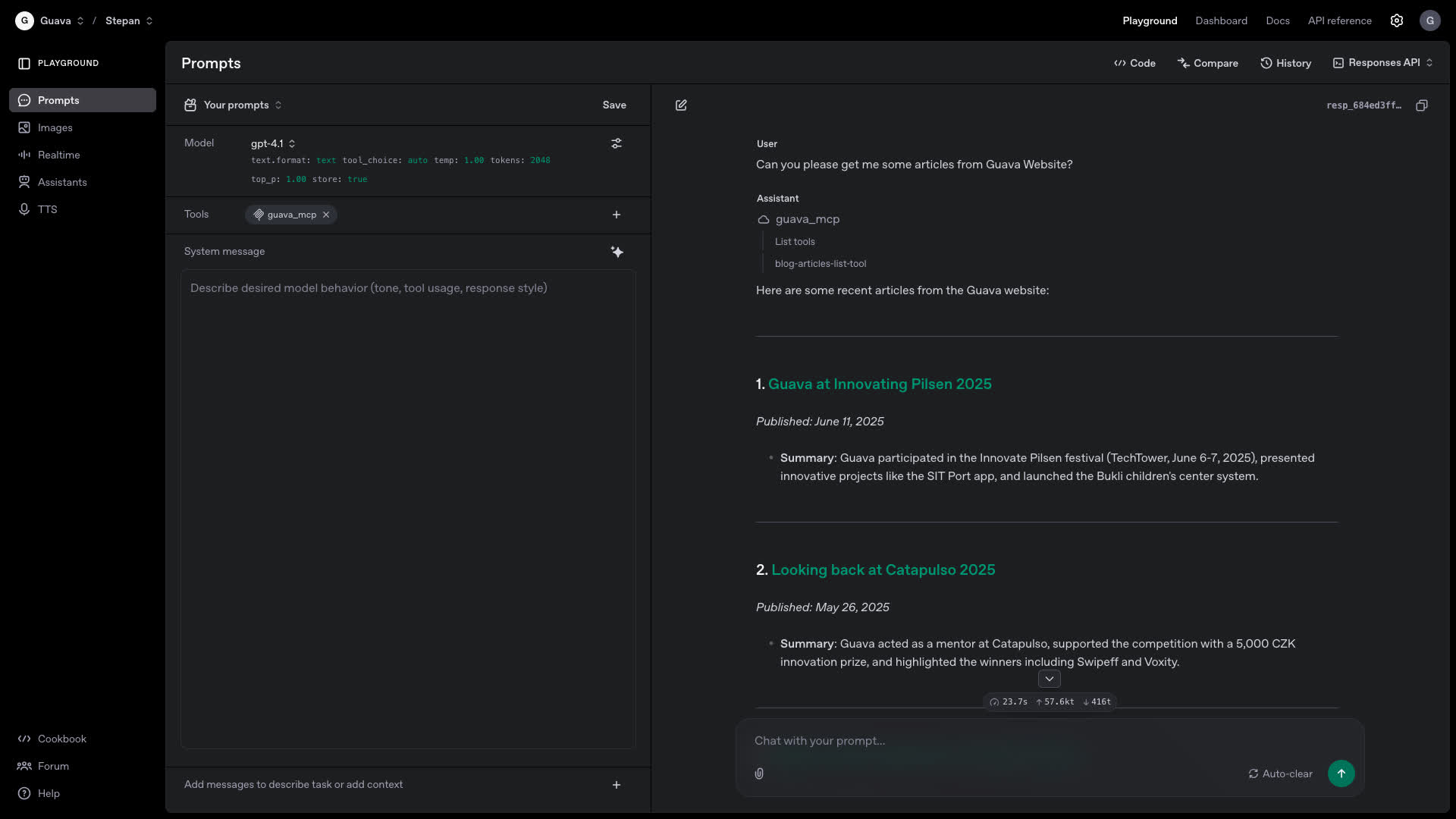

Öffnen Sie die OpenAI Playground-Plattform und wählen Sie "Prompts".

Wählen Sie das LLM-Modell.

Erstellen Sie ein oder mehrere neue Werkzeuge und verbinden Sie sie mit Ihrem MCP-Server.

Fragen Sie nun den LLM etwas wie "List all blog articles" oder "What version of Laravel does the site use?". Der LLM wird automatisch das richtige Tool aufrufen, die Daten vom Server abrufen und Ihnen eine echte und aktuelle Antwort geben.

Ist das nicht die Zukunft des Internets? KI-Agenten, die nicht nur raten, sondern "wissen".

Möchten Sie mehr erfahren oder eine Live-Demonstration sehen? Testen Sie die MCP-Endpunkte auf unserer Website (https://guava.cz/mcp) oder kontaktieren Sie uns. Die Zukunft ist näher als Sie denken.